先问候一声,这篇我们认真聊聊外企 AI 岗到底看什么。

2026 年 4 月,春招尾声,实验室里的打印机还在嗡嗡作响。

隔壁工位的师弟盯着屏幕上的 Anthropic AI Safety Fellow 岗位发呆,鼠标悬在“Apply”按钮上迟迟不敢点下去。

这种“想碰又怕碰”的心态,大概是当下外企 AI 岗求职者的集体缩影:明明刷了几百道 LeetCode,手边也攒了两个模型调优的项目,可一旦面对那些光鲜亮丽的 JD,心里还是没底。

为什么你的简历总是石沉大海?很大程度是因为你还在用 2023 年的标准准备 2026 年的面试。

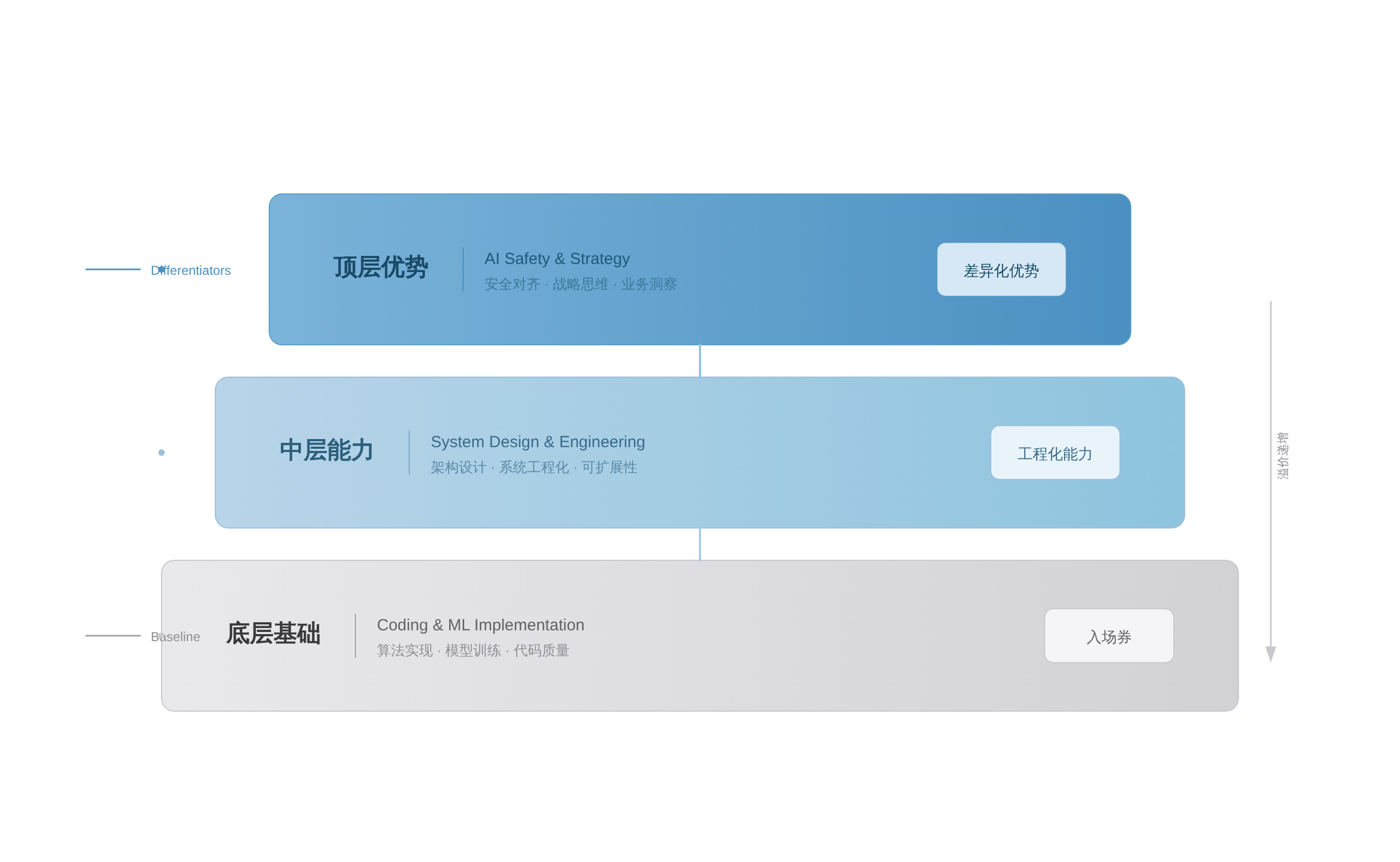

外企 AI 岗的筛选逻辑已经变了:Baseline expectations 只是入场券,Differentiators 才是决胜点。

如果你还停留在“刷题 + 调包”的层面,很可能连第一轮 Screening 都过不去。

Baseline Expectations:被误读的“入场券”

很多人以为外企 AI 岗的 Coding Round 还是那个熟悉的配方:两道 Medium,一道 Hard,写完跑通就完事。

但现实是,单纯考察 DSA(数据结构与算法)的时代正在过去。

根据 AI Engineering Field Guide 的定义,现在的 Coding 考察已经明确拆分为 DSA 和 ML Implementation 两部分 1。

这意味着,面试官不仅希望你写出高效的排序算法,更期待你能现场实现一个简化的 Transformer 模块,或者手推一个优化器的更新步骤。

不只是 LeetCode:Coding Round 的新变化

这种变化对求职者提出了更高的要求。以前你可以靠“背题”混过算法轮,但在 ML Implementation 环节,死记硬背完全失效。

你不仅要熟悉 PyTorch 或 TensorFlow 的 API,更要理解底层的数学原理。

比如,为什么 Transformer 里用 LayerNorm 而不是 BatchNorm?为什么梯度裁剪能缓解梯度爆炸?

这些问题没有现成的 LeetCode 题解,考察的是你对模型细节的真实理解。

ML Implementation:从“会用”到“能改”

会调用 torch.nn.Linear 不等于会 ML Implementation。外企面试官更看重你“魔改”模型的能力。当模型收敛速度变慢时,你能提出哪些改进方案?

当显存不足时,你知道如何通过梯度累积或混合精度训练来优化吗?这些问题的答案,决定了你是否能跨过 Baseline 的门槛。

一个只会照着教程敲代码的“调包侠”,在第一轮技术面就会被无情筛掉。

底层逻辑没打牢,上层建筑全是摇

Differentiators:拉开差距的“隐藏状态”

如果说 Baseline 决定了你能不能进门,那么 Differentiators 就决定了你能走多远。

在竞争激烈的外企 AI 岗招聘中,真正拉开差距的往往不是谁代码写得更快,而是谁的 System Design 更有深度,谁对 AI Safety 的理解更透彻。

System Design:AI 时代的架构师思维

当所有人都在刷 LeetCode 时,System Design 成了新的分水岭。

AI Engineering Field Guide 明确指出,AI System Design 考察的是你如何将模型融入真实系统 1。

这不再是简单的“输入数据 -> 模型推理 -> 输出结果”,而是一连串的工程化考量:数据如何流转?如何设计推理服务的高可用架构?当模型服务挂掉时,如何实现故障降级?

这些问题没有标准答案,但你的思考过程,就是面试官眼中的 Differentiator。

一个优秀的候选人,不仅能画出架构图,还能解释清楚为什么选择 Kafka 而不是 RabbitMQ,为什么用 Redis 做缓存而不是直接查数据库。

这种架构师思维,是区分“工程师”和“码农”的关键。

AI Safety 与 Ethics:外企的隐形红线

在 Anthropic 的 AI Safety Fellow 岗位 JD 中,Safety 意识被反复强调 [^1]。

在外企,尤其是 AI 前沿领域,对模型安全、伦理风险的考量,往往比单纯的技术能力更受重视。这不仅仅是政治正确,更是技术底线。

如果你在面试中能主动讨论模型可能存在的偏见、对抗样本攻击的风险,以及如何在训练阶段引入 RLHF(基于人类反馈的强化学习)来对齐模型行为,你就已经超越了 80% 只关注准确率的竞争者。

面试官突然问 Safety,心里一紧

沟通与协作:工程师的软实力

Behavioral 面试绝不是走过场。

AI Engineering Field Guide 整理了 100+ 来源的 Behavioral 问题,核心考察 Values、Leadership 和 Problem-solving 1。

你如何处理团队冲突?如何向非技术同事解释复杂的模型原理?当项目进度延期时,你如何推动各方协作?

这些软实力,往往是决定你能否拿到 offer 的关键一票。在外企的工程文化里,一个沟通顺畅、能推动落地的工程师,远比一个技术强但只会单打独斗的“独狼”更有价值。

Portfolio Strategy:如何构建你的“硬通货”

简历上的项目经历(Portfolio)是你能力的具象化呈现。但在面试官眼里,大部分校招生的 Portfolio 都像是“玩具大赏”。

项目选择:拒绝“玩具级”Demo

你的 Portfolio 里,有多少是跟着教程做的 MNIST 分类器?又有多少是在 Jupyter Notebook 里跑通的 Titanic 生存预测?

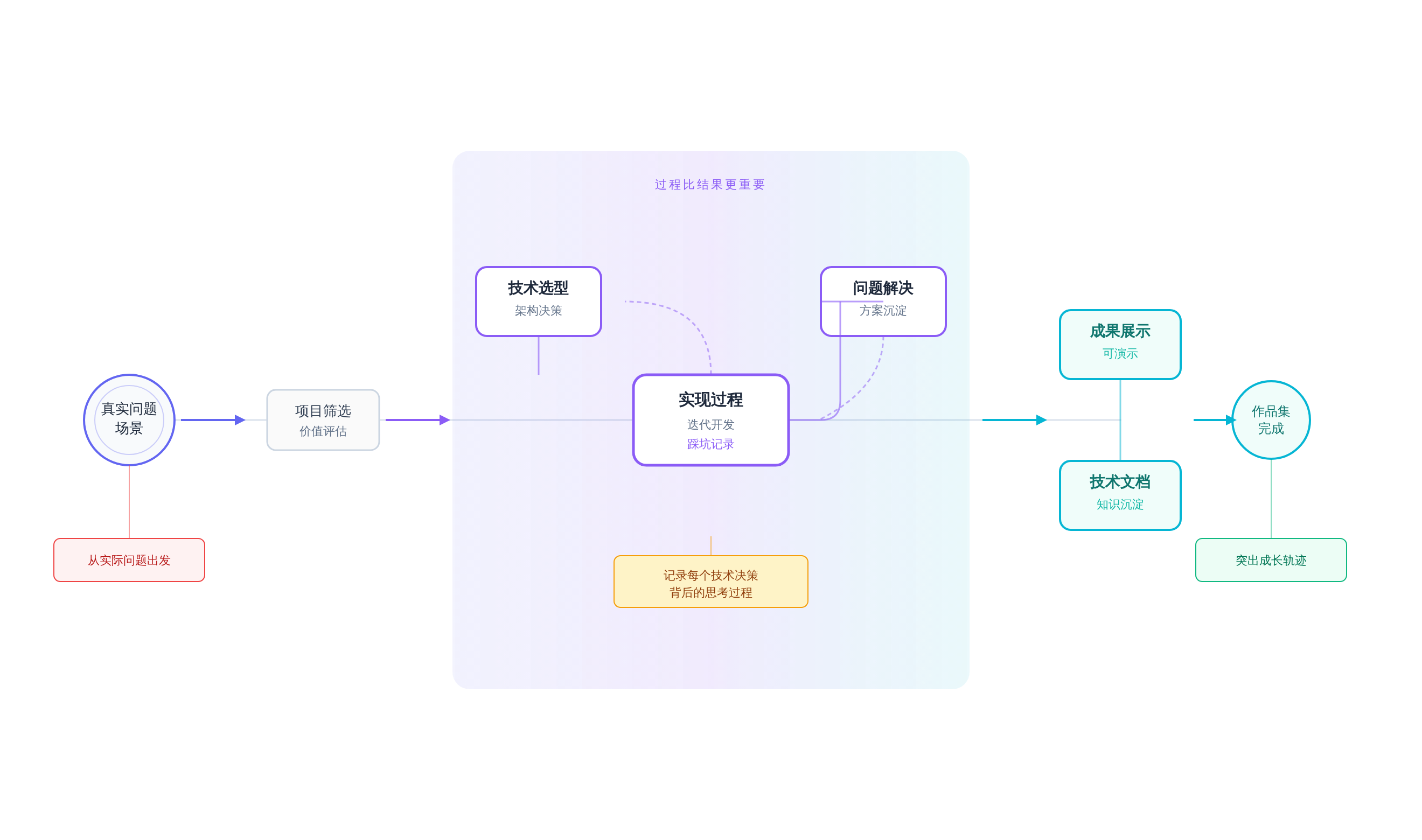

AI Engineering Field Guide 建议,真正的 Portfolio 应该展示 End-to-End 的能力 1。

这意味着,你需要展示从数据收集、清洗、模型训练,到服务部署、监控告警的全流程。

一个能跑在真实环境里、有完整 CI/CD 流水线的简单项目,比十个只能在 Notebook 里展示的复杂模型更有说服力。

展示策略:讲好一个技术故事

好的 Portfolio 不是项目的简单堆砌,而是一个完整的技术故事。在 README 文档里,你不仅要写“怎么做”,更要写“为什么”。为什么选择这个模型架构?

遇到了哪些具体的坑?你是如何权衡推理延迟与模型精度的?这些思考过程的文档化,本身就是一种 Differentiator。

它向面试官展示的不仅是你的代码能力,更是你的工程思维和解决问题的能力。

面试现场:Behavioral 与 System Design 的双重夹击

当你通过了简历筛选和 Coding 轮,真正的考验才刚刚开始。Behavioral 和 System Design 往往是决定最终 Level 和 Package 的关键环节。

Behavioral:价值观与领导力的考察

外企的 Behavioral 面试往往采用 STAR 法则(Situation, Task, Action, Result)。

但真正的高分回答,不是机械套用模板,而是展现你的价值观与公司文化的契合度。例如,Anthropic 强调 AI Safety,你的故事里是否体现了对技术风险的敏感?

OpenAI 看重 AGI 的普惠性,你的经历中是否有推动技术落地的案例?在回答问题时,不要只盯着“我做了什么”,更要展示“我为什么这么做”以及“我从中学到了什么”。

System Design:从需求到架构的推演

System Design 面试没有标准答案,但有清晰的考察路径:需求澄清 -> 容量估算 -> 架构设计 -> 瓶颈分析。

在 AI 场景下,你还需要额外考虑数据管道、模型版本管理、A/B 测试等环节。

比如,设计一个推荐系统,你不仅要考虑模型结构,还要设计特征存储、实时流处理、离线训练和在线推理的完整链路。

面试官关注的不是你画出一张完美的架构图,而是你在面对模糊需求时,如何通过提问澄清边界,如何在资源受限时做出取舍。

面试官:如果 QPS 翻倍,你的架构怎么扛?

写在最后

外企 AI 岗的竞争已进入“深水区”。

Baseline expectations 让你获得面试机会,Differentiators 决定你能否拿到 offer,而 Portfolio 是你所有能力的具象化呈现。

与其焦虑 HC 缩减,不如现在打开你的 GitHub,看看里面有多少能拿得出手的 End-to-End 项目。

2026 年的求职市场,不再奖励“刷题机器”,而是奖励那些真正理解技术本质、具备工程落地能力的“问题解决者”。

你的 Portfolio 里,有几个是真正解决过实际问题的?欢迎在评论区分享你的项目经历。

参考文献

如果你想继续追更,欢迎在公众号 计算机魔术师 找到我。后续的新稿、精选合集和阶段性复盘,会优先在那里做串联。