先和你打个招呼,今天这篇想顺着几条公开信号,聊聊这件事为什么值得工程师盯住。

2026 年 4 月,如果你同时刷到两条关于微软的新闻,可能会觉得编辑搞错了时间线。

一边是彭博社报道,微软 CFO Amy Hood 亲自踩下刹车,暂停或推迟了在澳大利亚、印尼、英国以及美国本土多个州的数据中心项目1;

另一边,微软官方高调宣布,将在 2026 至 2029 年间向日本砸下 100 亿美元,用于 AI 基础设施、网络安全和人才培养2。这看似矛盾的操作,其实是一盘下了很久的棋。

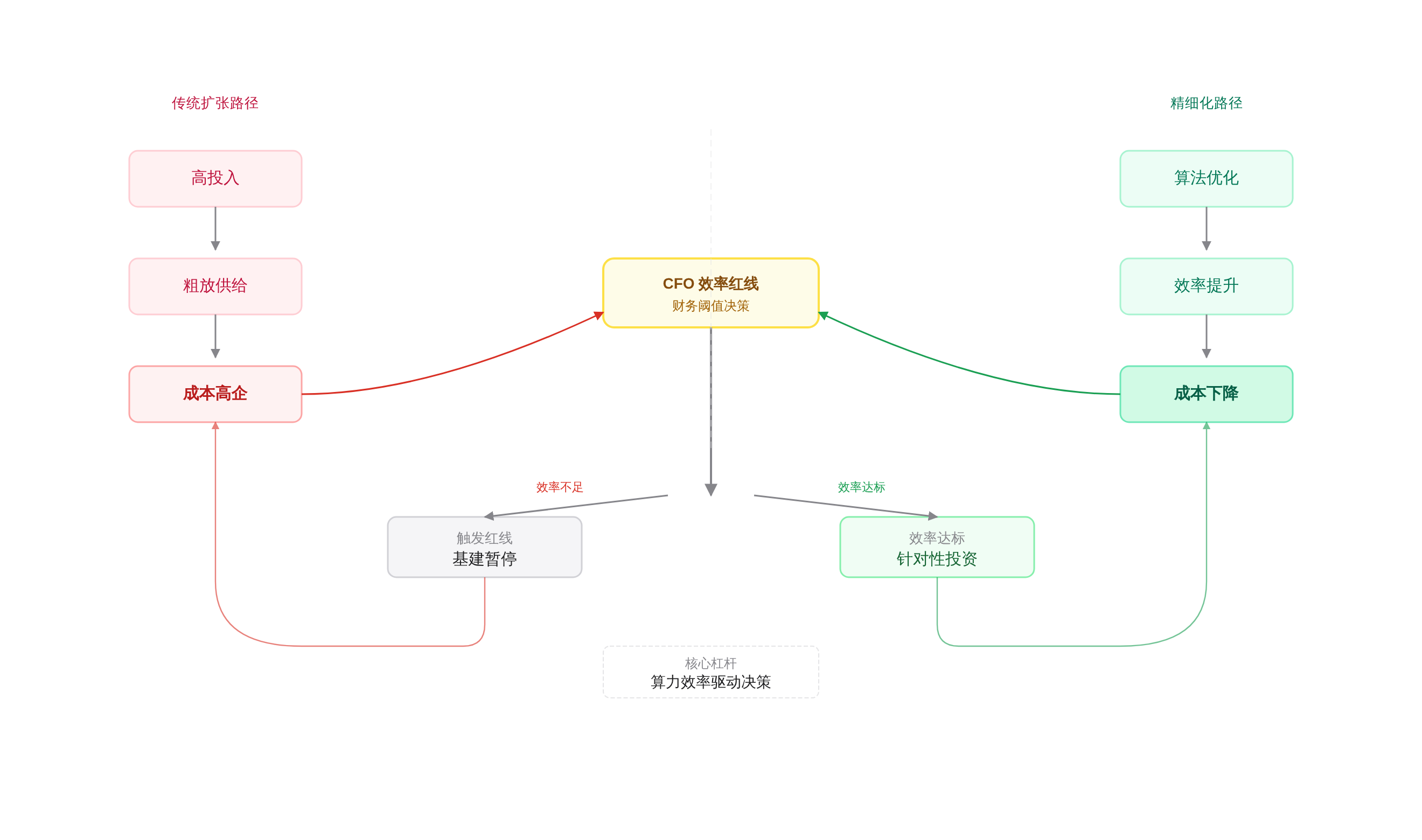

AI 的基建狂奔时代结束了,精细化算力时代开始了。如果你只看到“暂停”,可能会误判 AI 泡沫破裂;如果你只看到“投资”,又可能忽视算力供需结构的根本性翻转。

这两条信号夹在一起,才藏着微软对未来三年的真实判断。

踩刹车还是换挡?数据中心调整的真相

并非需求崩塌,而是算力效率重估

看到微软暂停数据中心建设,很多人的第一反应是:AI 需求是不是不行了?恰恰相反,这更像是一次基于技术演进的效率重估。

过去两年,大模型训练被默认为一场“暴力美学”的竞赛,谁堆的卡多,谁就能赢。但 2026 年初,DeepSeek-R1 等低成本模型的出现,打破了“算力即正义”的单一叙事。

根据至顶网的报道,这些模型证明了,通过算法优化,完全可以在更少的算力上达到接近顶级模型的效果,这直接挑战了“必须耗资数十亿美元建设 AI 数据中心”的传统认知3。

这意味着,未来推理需求的增长,未必需要通过线性增加数据中心来满足。微软的调整,本质上是在回应这种变化。

与其盲目扩建可能在未来几年就被更高效架构淘汰的“笨重”机房,不如停下来重新评估技术路线。这不是需求崩塌,而是需求形态的进化。

对于工程师而言,这意味着单纯靠“堆硬件”解决性能问题的时代正在过去,算法与系统的协同优化将成为新的核心竞争力。

你的方案如果能用更少的算力跑出同样的效果,在当下的环境里就是最大的加分项。

CFO 的刹车片:资本开支的效率红线

这次调整的另一个关键信号,是 CFO Amy Hood 的强势介入。根据彭博社的报道,正是她在 2024 年底发现单季度资本开支激增且回报周期拉长后,果断叫停了部分项目1。

这释放了一个明确信号:微软对 AI 投资的态度,正从“不计成本抢占身位”转向“追求商业回报”。对于上市公司,这无可厚非;对于技术团队,这意味着“烧钱换增长”的特权正在消失。

未来的技术决策,将面临更严苛的财务审视。

老板:这个季度的云预算先砍一半

这种逻辑传导到工程层面,就是项目立项的严格审查。以前可能只要沾上 AI 就能批预算,现在则需要更详尽的算力成本收益分析。这要求架构师不仅要懂系统设计,还要懂模型选型与成本控制。

当模型训练成本曲线向下弯曲时,继续按旧曲线扩张基建,无异于在高位接盘。工程师在申请资源时,最好提前准备好“这笔钱能带来多少收益”的答案,而不是只谈技术先进性。

这听起来很残酷,但却是行业走向成熟的必经之路。

100 亿砸向日本,微软在买什么?

数据主权:算力留存在本土的新刚需

既然在收缩全球基建,为什么又要重注日本?答案藏在“数据主权”四个字里。

微软官方公告中明确提到,将与 Sakura Internet 和 SoftBank 合作,在日本本土提供 GPU 算力服务,并确保数据驻留2。

这并非简单的商业合作,而是对日本政府“数据不出境”诉求的精准回应。随着 AI 成为国家级战略资产,各国对数据跨境流动的监管日益收紧。

对于日本这样对数据隐私高度敏感的市场,单纯依靠微软全球云网络已无法满足合规要求。

这笔 100 亿美元(约合 1.6 万亿日元)的投资,本质上是微软在购买“合规入场券”。通过建设本地化算力,微软不仅锁定了日本政府和企业的大单,还构建了竞争对手难以逾越的合规壁垒。

SoftBank 总裁兼 CEO 宫川润一在公告中明确表示,这种合作将使客户能够在 Microsoft Azure 环境中利用 SoftBank 的 AI 计算平台,即使在高机密性和数据主权领域也能放心使用 AI2。

对于出海企业来说,这是一个重要信号:未来的全球化架构设计,必须将数据主权作为第一性原理,而不是事后补救的合规补丁。

信任与安全:国家级网络安全合作

除了算力,这笔投资还重点投向了网络安全。微软将加强与日本国家网络安全中心(NISC)和警察厅的合作,共享威胁情报,打击网络犯罪。

这已经超出了普通商业合作的范畴,上升到了国家安全的战略高度。根据路透社的报道,这项投资涵盖了 AI 基础设施扩展和网络安全防御强化4。

在当前的地缘政治环境下,技术公司的竞争力不仅取决于产品性能,更取决于其与各国政府的信任关系。

这种“信任红利”对于工程师来说可能有些遥远,但它直接决定了技术方案的可落地性。在某些敏感行业,选择一家与政府关系紧密的云服务商,往往比选择一家技术更先进但政治风险高的服务商更稳妥。

微软的数字犯罪部门(DCU)将与日本警察厅合作, dismantling 恶意基础设施,这种国家级的背书是单纯的技术优势无法替代的。这听起来不够“极客”,但却是现实世界的运行规则。

人才护城河:填补 326 万 AI 工程师缺口

微软承诺在 2030 年前为日本培训 100 万 AI 工程师,这看似是公益行为,实则是为了填补日本预计高达 326 万的 AI 人才缺口2。

通过培训,微软不仅输出了技术标准,还提前锁定了未来的开发者生态。这些工程师熟悉微软的工具链,未来大概率会成为 Azure 的忠实用户。

数据显示,微软 365 Copilot 目前已被 94% 的日经 225 指数公司使用2,这种渗透率背后是强大的生态锁定效应。

这对国内的技术教育也有启示。与其泛泛地谈“AI 人才缺口”,不如像微软这样,将人才培养与具体的产业需求、工具生态绑定。

对于个人开发者而言,选择技术栈时,除了看热度,也要看背后的生态支持与职业路径清晰度。

微软通过与富士通、日立、NEC、NTT Data 和 SoftBank 五家公司的合作,确保了培训内容与实际产业需求的无缝对接,这种“订单式”的人才培养模式,远比泛泛的 AI 课程更有价值。

空芯光纤与底层技术:被忽视的护城河

47% 的提速:光通信的物理突破

在微软 Ignite 大会上,一项看似不起眼的技术发布其实分量极重:新一代空芯光纤技术。这种光纤用空气作为导光介质,实现了比传统玻璃光纤快 47% 的传输速度5。

对于 AI 这种对延迟极度敏感的工作负载,这种物理层面的提速,比单纯堆算力更有价值。它意味着跨数据中心训练、推理的效率将大幅提升,算力调度的半径得以扩大。

根据雪球专栏的分析,微软已在英国数据中心部署了空芯光纤,并利用多芯光纤技术强化海底电缆5。

这提醒我们,AI 的竞争不仅发生在模型层,更发生在基础设施层。当大家在卷 Transformer 架构时,巨头们正在卷光缆、卷芯片、卷散热。

这种“硬核”创新往往被忽视,但却是决定最终性能上限的关键。光在空气中的传播速度比在玻璃中快,这个物理学常识被微软转化为了实实在在的竞争优势。

这种底层技术的突破,往往比模型层面的微调更具长远价值。

从芯片到光纤:全栈自研的“硬”实力

从自研 Maia 芯片,到收购 Lumensity 布局空芯光纤,微软正在构建一套从底层硬件到上层软件的全栈技术体系5。

这种垂直整合能力,让微软在面对供应链波动和技术路线变更时,拥有比纯软件公司更强的抗风险能力。

这也是为什么即便在缩减数据中心项目时,微软依然在底层技术上重金投入的原因——基建可以暂缓,但技术储备不能停。

对于工程师来说,关注这些底层技术演进,有助于跳出框架思维,在系统设计时拥有更多维度的考量。比如,在设计高并发系统时,除了优化代码,是否考虑过网络层面的物理限制?

这种跨层思考能力,是资深架构师与普通开发者的分水岭。微软的空芯光纤技术不仅降低了延迟,还消除了光纤的非线性,增加了带宽,这种多维度的性能提升,是单纯依靠软件优化无法企及的。

给工程师的信号:从“堆算力”到“懂算力”

边缘与断连场景:Azure Local 的实战意义

微软在日本投资中特别提到了 Azure Local,支持断连环境下的云原生应用运行2。这看似是为了满足特定行业的合规需求,实则指向了 AI 落地的一个关键场景:边缘计算。

随着 AI 渗透到制造、医疗等对延迟和数据隐私要求极高的行业,完全依赖云端算力已不现实。Azure Local 这种“云边一体”的架构,将成为未来企业级 AI 应用的标配。

它允许客户在客户控制的基础设施上运行关键工作负载,同时保持与 Azure 一致的治理和策略控制。

这对工程师的技能树提出了新要求。你不仅要懂云端架构,还要懂边缘设备的资源限制、断网重连的数据同步策略。这种“在约束条件下做设计”的能力,比单纯追求高并发更具挑战性,也更稀缺。

微软扩展 Azure Local 以支持间歇性连接或完全断开公共云的环境,正是为了应对那些对治理和韧性要求最严苛的场景。

这种技术路线的选择,反映了微软对 AI 落地复杂性的深刻理解。

合规即架构:数据驻留带来的新约束

无论是日本的数据主权要求,还是欧盟的 GDPR,合规正在成为架构设计的一等公民。以前,合规往往是上线前的检查项;现在,它必须内嵌到系统设计的每一层。

比如,如何设计多租户架构以实现数据物理隔离?如何在保证数据驻留的前提下实现跨区域容灾?这些问题没有标准答案,需要工程师在理解业务和法律的基础上,做出技术权衡。

GitHub Enterprise Cloud 现在已提供日本境内的数据驻留服务2,这表明微软正在将“合规”能力产品化。

合规:这锅我不背,但架构得改

技能树调整:从模型调优到系统成本控制

微软的这波操作,给所有工程师提了个醒:行业正在从“模型为王”转向“系统为王”。当模型训练成本下降、开源模型普及后,竞争的焦点将转移到如何高效、稳定、合规地部署这些模型。

这意味着,你的技能树需要从单纯的模型调优,扩展到系统成本控制、网络优化、合规架构设计等领域。懂模型的人会越来越多,但懂算力、懂系统、懂成本的工程师,永远是稀缺资源。

微软的财报显示,其云业务毛利率的提升与基础设施效率的优化密切相关,这背后是对系统成本控制能力的直接回报。

写在最后

微软的“刹车”与“油门”,看似矛盾,实则是对 AI 行业进入深水区的精准反应。算力不再是取之不尽的电力,而是需要精细运营、合规约束的战略资产。对于工程师而言,这既是挑战也是机遇。

当风口从“做大模型”转向“用好模型”,那些能看懂财报背后的技术逻辑、能在约束条件下构建高效系统的人,将成为下一个十年的主角。

你现在的项目里,算力成本是已经优化的瓶颈,还是还没被关注的黑盒?欢迎在评论区聊聊你的看法。

风险提示与免责声明:本文仅基于公开资料讨论公司公告、技术投入与行业信号,用于研究和信息分享,不构成投资建议,也不作为投资依据。

参考文献

Microsoft CFO's AI Spending Runs Up Against Tech Bubble Fears

Microsoft deepens its commitment to Japan with $10 billion investment in AI infrastruct...

Microsoft to invest $10 billion in Japan for AI and cyber defence expansion

如果你想继续追更,欢迎在公众号 计算机魔术师 找到我。后续的新稿、精选合集和阶段性复盘,会优先在那里做串联。