2026 年 4 月的一个周三下午,技术群里跳出一张截图,瞬间把昏昏欲睡的群聊炸醒了。

某大厂 AI 岗面试题,没问 Transformer 的层数,也没让推导反向传播,第一道题是:“给你 2 张 A10 显卡,怎么把 70B 模型跑起来,还要保证并发 20 QPS 的延迟在 500ms 以内?

”

群里沉默了三秒,有人回了一句:“这题我熟,上个月我也挂在这。”紧接着是一排“裂开”的表情包。这一幕在 2026 年的春招季并不罕见。

很多准备了大半年“八股文”的候选人发现,面试官的问题变了:不再纠结于模型参数的微调细节,而是盯着你的工程落地能力、系统设计思维,甚至是对 AI 成本的控制意识。

这不仅仅是面试风格的微调,而是整个 AI 岗位画像的根本性位移。如果你还在死磕 Transformer 的层数和参数,可能需要停下来想一想:你的技能树,是不是长反了方向?

岗位画像变了:从“炼丹师”到“工程兵”

如果你仔细翻看 OpenAI 或 Anthropic 的最新招聘页面,会发现一个明显的趋势:纯“算法研究员”的坑位在变少,而“应用工程师”“系统工程师”的坑位在变多。

这背后的逻辑并不复杂——模型本身正在变成一种基础设施,行业竞争的焦点从“谁模型更强”转移到了“谁更能把模型用好”。

以 OpenAI 最近招聘的 Android Engineer (Applied AI) 为例,薪资开到了 $230K – $385K,外加 Equity。

但要求里写得清清楚楚:你需要把 AI 能力装进移动端产品里,处理设备端的推理优化,而不是在实验室里刷榜。

这要求你既懂 Android 生命周期,又懂模型量化,还得明白怎么在手机发热和响应速度之间做权衡。这不再是单纯的算法岗,而是典型的“AI + 工程”混合体。

对于正在准备求职的本科生和研究生来说,这意味着你手里的“模型调优”经验可能不再是敲门砖,反而成了锦上添花的点缀。市场需要的是能把模型变成服务的人,而不是只会调参的人。

如果你的简历上只有 Kaggle 比赛名次,却写不出一个高可用的推理服务架构,在 2026 年的筛选系统里,你可能会被算法无情地过滤掉。

这哪里是面试,分明是现场排障

编码轮:不再只考 LeetCode,还要考 ML 实现

传统的 Coding 轮通常只考数据结构与算法(DSA),但在 AI 工程师的面试中,这一环节正在被重新定义。

根据 AI Engineering Field Guide 的总结,现在的 Coding 轮往往包含 ML implementation,考察重点从“你会不会写算法”变成了“你会不会写工程代码”。

从 DSA 到 ML Implementation

面试官可能会让你手写一个简单的数据预处理管道,或者实现一个模型推理的 API 接口。这听起来比手撕红黑树简单,但坑在于工程细节。比如,如何处理数据加载的并发问题?

如何设计 API 的超时和重试机制?如何保证输入数据的安全性?这些问题没有标准答案,但能一眼看出你是不是真的写过生产代码。

举个例子,面试官可能会给你一段充满坏味道的 ML 代码,让你重构。这段代码可能没有类型提示,没有异常处理,甚至把模型加载写在了循环里。

如果你平时只用 Jupyter Notebook,习惯了“能跑就行”,这轮可能会挂得很惨。因为 Notebook 是实验场,而面试官要的是能上战场的工程兵。

⚠️ 踩坑提醒

很多候选人习惯性地刷 LeetCode,却忽略了 Python 工程化能力的训练。建议在准备面试时,刻意练习一下 Python 的类型系统、异步编程和单元测试。

试着把自己之前的实验代码重构成一个标准的 Python Package,加上 setup.py 和完善的文档。这比多刷 50 道 LeetCode 更能打动面试官。

系统设计:AI System Design 成为新拦路虎

以前准备 System Design,背熟“高并发”“分布式缓存”可能就够了。但现在,AI 岗的系统设计题有了专门的分类:AI System Design。

面试官会问你:如何设计一个 RAG 系统?向量数据库选型怎么考虑?如果模型推理太慢,有哪些优化手段?

这些问题直击 AI 落地的痛点。

通用架构题不够用了

AI System Design 的核心在于权衡。你不仅要考虑传统的系统指标,还要考虑模型特有的问题,比如显存占用、推理延迟、Token 成本等。

以一个真实的面试题为例:“设计一个支持百万级文档的 RAG 系统”。你需要考虑的不仅仅是选哪个向量库,还要考虑文档切片策略、索引更新机制、以及如何在召回率和延迟之间做权衡。

这些问题没有标准答案,但能暴露你是否真的做过项目。如果你只能说出“用 LangChain 搭一下”,面试官大概率会追问:“LangChain 底层是怎么实现的?

它的召回策略有什么问题?”这时候,如果你对底层原理一知半解,很容易被问住。

架构分层与瓶颈分析

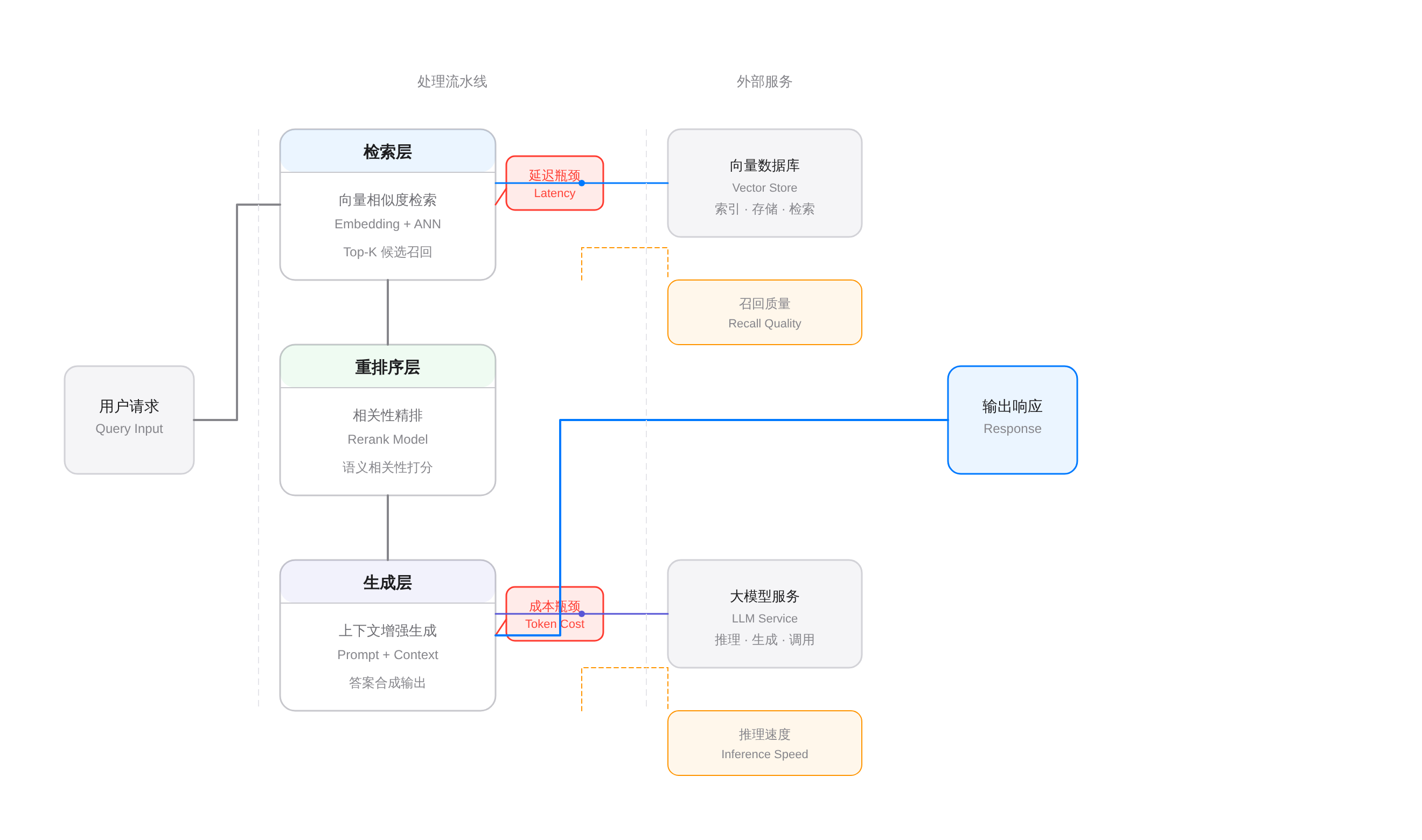

为了更直观地理解 AI System Design 的考察点,我们可以把一个典型的 RAG 系统拆解成下面的架构。面试时,建议先画出类似的分层架构,再逐层分析瓶颈和优化点。

在检索层,你需要关注召回率和查询延迟。如果文档量级很大,简单的向量检索可能不够,需要引入倒排索引或混合检索。在生成层,推理延迟和 Token 成本是两大瓶颈。

面试官可能会问你:“如果用户问的问题很简单,不需要大模型,怎么优化?”这时候,如果你能提出“意图识别 + 路由”的方案,把简单问题分流给小模型或规则系统,就是一个很好的加分项。

架构图画得再好,一问细节就露馅

行为面试:安全与伦理不再是走过场

在 Anthropic 等 AI 安全导向的公司,行为面试的权重甚至超过了技术轮。他们会考察你对 AI Safety 的理解,以及在面对伦理困境时的决策逻辑。这不再是走过场,而是实打实的筛选标准。

价值观匹配度被放大

AI 技术的快速发展带来了前所未有的伦理挑战。模型偏见、数据隐私、生成内容的安全性,这些问题在传统软件开发中可能只是边缘话题,但在 AI 公司却是核心议题。

面试官可能会问你:“如果你的模型生成了有害内容,你会怎么处理?”或者“如何在保护用户隐私的前提下使用数据?”

这些问题没有标准答案,面试官想看的是,你是否具备在真实世界里“负责任地部署 AI”的意识。

如果你在回答中能引用一些业界最佳实践,比如红队测试、对抗性攻击防御,或者提到 Anthropic 的 Constitutional AI 理念,会显得你非常有备而来。

如何准备

不要只准备“项目难点”这类常规问题,还要准备一些关于 AI 伦理、模型偏见、数据隐私的思考。

平时可以多读读 AI Safety 相关的论文和博客,比如 Anthropic 的官方博客就经常发布高质量的技术文章。

在面试中,展现出一个工程师的社会责任感,往往比多写一行代码更能打动面试官。

写在最后

2026 年的 AI 工程师面试,本质上是在筛选一类新人:他们既懂模型的边界,又懂系统的瓶颈。他们不再是只会调参的“炼丹师”,而是能把 AI 变成可靠服务的“工程兵”。

这一轮面试变革,对你是机会还是挑战?如果你还在死磕 Transformer 的层数和参数,可能需要停下来想一想:你的技能树,是不是长反了方向?

欢迎在评论区聊聊你最近遇到的 AI 面试题,看看是不是也变了味儿。

参考文献

如果你想继续追更,欢迎在公众号 计算机魔术师 找到我。后续的新稿、精选合集和阶段性复盘,会优先在那里做串联。