养虾群里最近有点躁动。好几个老用户突然开始讨论一个叫 Hermes Agent 的东西,有人说「用了就回不去了」,有人直接甩出迁移命令截图。

GitHub 上线才两个月,Stars 已经冲到 3 万多,讨论热度把不少小龙虾老用户都卷进去了。

这事儿和每个用 AI 助手的人都有关:你有没有经历过那种崩溃——明明上周刚告诉过它你的项目结构、代码规范、偏好设置,这周打开对话,它又像第一次见面一样问你「请问你想做什么?

」传统 AI 助手最大的问题不是不够聪明,而是它永远活在「当下」,没有「上次」的概念。Hermes Agent 之所以能让一群老用户「叛逃」,核心就在两个字:记忆。

今天这篇文章,我们来拆解它的三层记忆架构和自学习闭环,看看一个 AI 助手到底怎么做到「记住你」。

一、根因:为什么传统 AI 助手总是「失忆」?

传统 AI 的记忆困境

绝大多数 AI 助手的设计逻辑,本质上还是一个「大号对话窗口」。每次对话开始,模型拿到的是系统提示词 + 当前对话历史,上下文窗口塞满就截断。你上周告诉它的东西,这周它根本看不到。

这不是模型不够聪明,是架构就没打算让它记住。

小龙虾的 MEMORY.md 试图解决这个问题,思路很朴素:让模型在对话过程中自己判断哪些信息「值得存」,然后写入一个 Markdown 文件。但问题在于,模型经常「忘存」。

你随口提了一句「我们项目用 TypeScript,后端是 Go」,模型觉得这是闲聊,没存。下周你再问,它又不知道了。

社区为此搞出了 Mem0、Hindsight 等一堆补丁插件,本质上都是在给这个「漏存」问题打补丁。

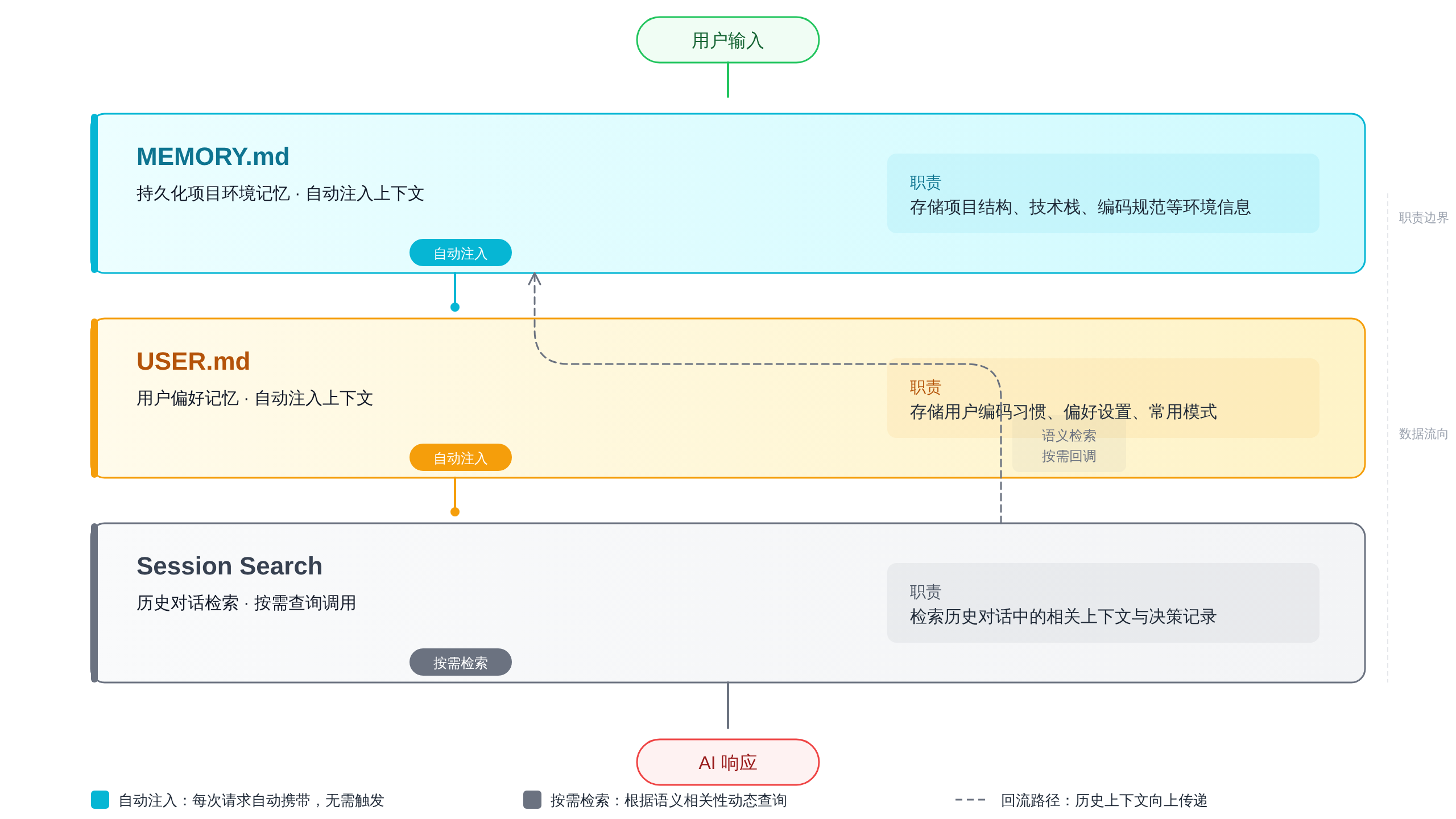

Hermes 的三层记忆架构

Hermes 换了个思路。它不依赖模型「想起来要存」,而是把记忆拆成三层,每层有明确的职责边界和自动注入机制。

第一层是 MEMORY.md,存环境和项目信息,上限 2200 字符。你的项目结构、技术栈、代码规范,都往这里放。每次对话开始,这个文件自动注入上下文,模型不需要「想起来」,它本来就在那儿。

第二层是 USER.md,存用户偏好和习惯,上限 1375 字符。你喜欢简洁的回答还是详细解释,你习惯用中文还是英文,你常用的工具链是什么。同样,每次对话自动注入。

第三层是 Session Search,所有历史对话存在 SQLite 里。当你问「上周我们讨论的那个 API 怎么调来着」,系统会用全文检索加大模型摘要,从几周前的对话里精准找回来。

这个设计的关键在于:记忆写入不再依赖模型的「自觉」,而是通过结构化的存储和自动注入,让「记住」成为默认行为。你告诉它一次,它就真的记住了。

二、自学习闭环:AI 怎么「自己学会干活」?

程序性记忆:从任务中提炼 Skill

记忆只是第一步。Hermes 更激进的地方在于,它能把「怎么干活」也记住。

传统 AI 助手的 Skills(技能)都是人写的。小龙虾社区贡献了 5700 多个 Skills,每个都是一份 Markdown 文件,定义了「如何完成某个任务」。

你装什么,它就会什么。但如果你有一个独特的任务流程,没人写过对应的 Skill,你就得自己写。

Hermes 引入了「程序性记忆」的概念。

当你完成一个复杂任务——比如「从数据库导出数据、清洗格式、生成报告、发送邮件」——系统会检测到这是一个超过 5 次工具调用的复杂流程,然后自动提炼成一个 Skill。

下次你再说「帮我做上周那个报告」,它会直接调用这个 Skill,而不是从头推理一遍。

更关键的是,这个 Skill 会「进化」。如果后续使用中,模型发现了一条更优路径——比如用一个新的 API 替代了手动清洗——它会自动更新这个 Skill。你不需要手动维护,它自己在变好。

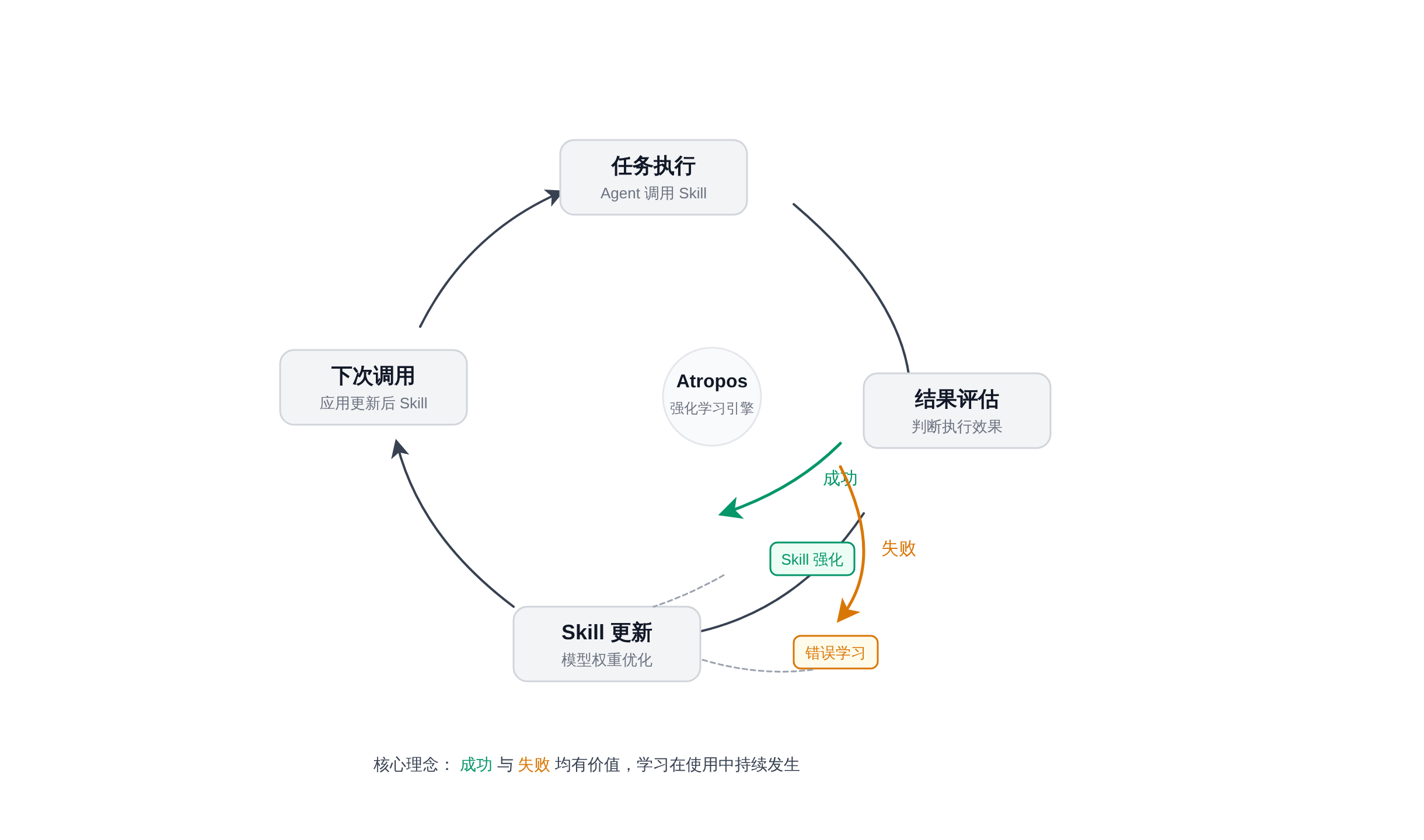

Atropos 强化学习:成功强化、失败学习

这套自学习机制的底层,是 Nous Research 的 Atropos 强化学习框架。

传统 AI 助手的「学习」只发生在训练阶段。模型训练完了,能力就锁死了。Hermes 的思路是:让学习发生在使用过程中。

当它成功完成一个任务,这个交互模式会被「强化」;当它失败了,它会学习「哪里出了问题」。

这听起来有点抽象,但实际体验就是:你用得越多,它越懂你。它不是在「执行指令」,而是在「积累经验」。这个区别,用久了才能感受到。

三、安全设计:框架级防护 vs 模型级判断

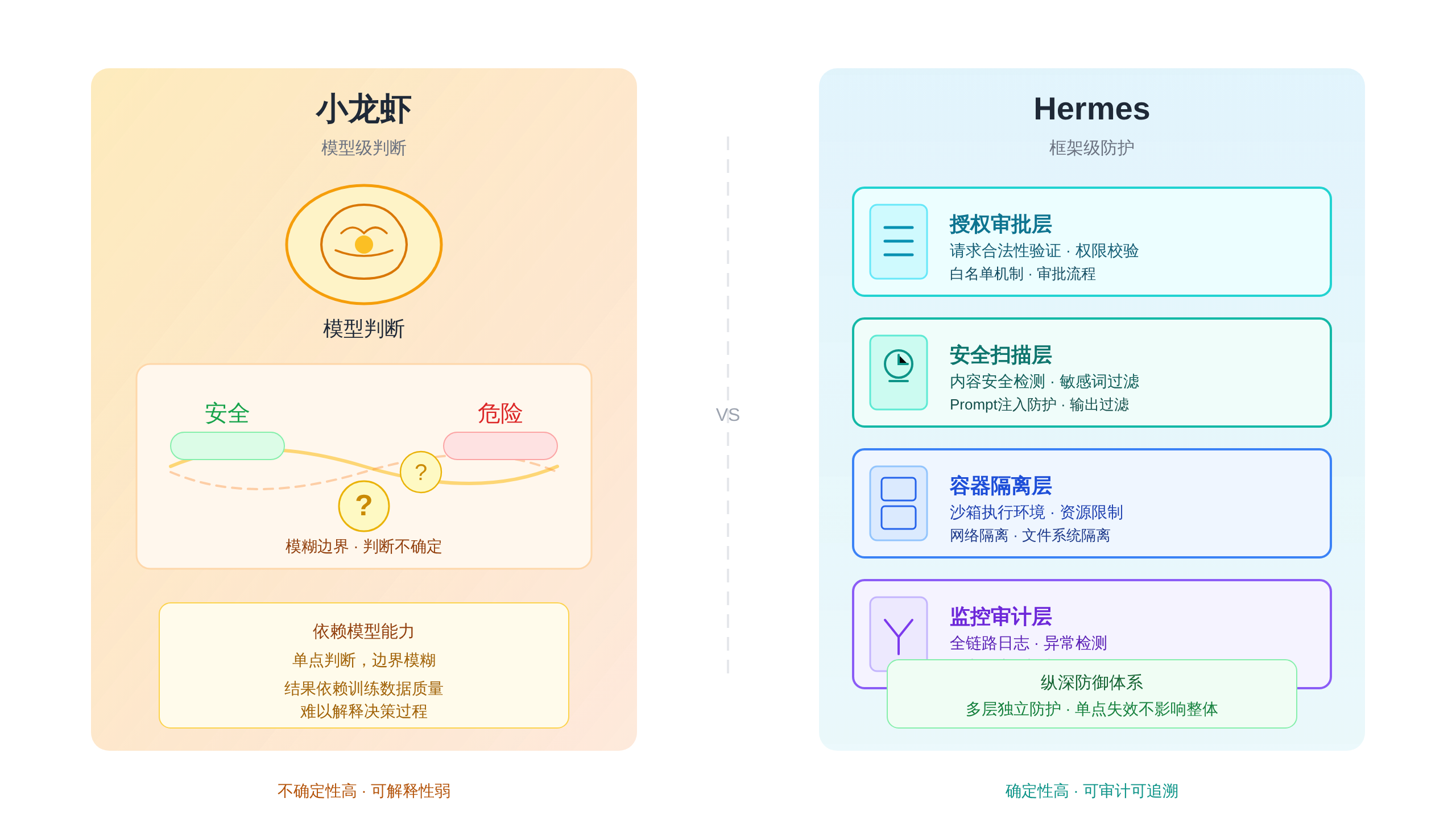

小龙虾 CVE-2026-25253 的教训

AI 助手能操作你的电脑,这事儿本身就有点吓人。小龙虾的安全机制主要依赖模型的判断力:模型觉得这个操作安全,就执行;觉得危险,就拒绝。

问题在于,模型不是永远聪明的。它可能被提示词注入欺骗,可能在上下文混乱时做出错误判断。CVE-2026-25253 漏洞就是一个例子:恶意构造的输入可以绕过安全检查,执行任意命令。

还有用户报告过邮件被误删的事故——模型「觉得」这是清理垃圾邮件,结果把重要邮件全清了。

模型犯浑的时候,你连锅都找不到

这些事故的根因是:安全边界模糊,责任落在模型身上。模型今天状态好,就安全;状态不好,就出事。

Hermes 的多层安全机制

Hermes 把安全从「模型级判断」升级到了「框架级防护」。

首先是命令授权审批。任何敏感操作——删除文件、发送邮件、调用外部 API——都会弹出确认界面。你可以选择单次允许、本次会话允许、永久允许或直接拒绝。这个决定权在你手里,不在模型手里。

其次是第三方 Skills 的安全扫描。当你安装一个社区贡献的 Skill 时,Hermes 会自动检查是否存在数据泄露、提示词注入等威胁。

发现危险的不是弹个警告让你自己判断,而是直接拒绝安装,除非你明确用 --force 参数。

此外还有容器隔离、凭证泄露拦截、受保护目录禁止访问、路径穿越防护。记忆文件注入系统提示词之前,也要过安全扫描。这套机制的核心逻辑是:不赌模型今天心情好不好,而是在框架层面把危险操作锁死。

这不是说 Hermes 绝对安全——任何能操作你电脑的工具都有风险。但它的设计思路更符合工程实践:安全不能靠「智能」,要靠「约束」。

四、实战:怎么装、怎么用、该不该换?

极简安装流程

Hermes 的安装比小龙虾简单得多。唯一前置条件是 Git,其他依赖——Python 3.11、Node.js、ripgrep、ffmpeg——安装器全部自动搞定。

最简单的方式是 Docker:

docker pull nousresearch/hermes-agent

docker run -it --rm \

-e ANTHROPIC_API_KEY=your_key \

-v hermes_data:/app/data \

nousresearch/hermes-agent

如果你习惯源码安装,也只需要几步:

git clone https://github.com/NousResearch/hermes-agent.git

cd hermes-agent

pip install -r requirements.txt

python -m hermes

云端部署也很方便。腾讯云轻量服务器选择 Hermes 镜像,2 核 4G 配置就能跑起来,支持飞书、Telegram 等 15+ 消息平台接入。

与小龙虾的迁移对比

如果你已经是小龙虾用户,Hermes 提供了一键迁移命令:

hermes claw migrate --dry-run # 先预览

hermes claw migrate # 正式迁移

这会把小龙虾里的记忆、技能和 API Key 都导过来。--dry-run 参数让你先验货,不满意可以不搬。

还有一个关键差异:Hermes 原生支持 Claude 凭证登录。小龙虾用户都知道,Claude 已经封杀了小龙虾的订阅套餐登录,只能走 API 计费。

Hermes 目前还能直接用 Claude 的原生登录,这对重度 Claude 用户来说是个不小的诱惑。

适用人群判断

说了这么多,该不该换?我给一个简单的判断框架:

如果你已经养了虾、养得挺舒服的,别急着搬家。两只虾不冲突,迁移也就一条命令的事,可以先装一个试试水。

如果你还没入坑,我反而建议先试 Hermes。上手更简单,文档更友好,自学习是真实的,还能用 Claude 额度。唯一门槛是目前中文资料几乎为零。

如果你喜欢 Claude Code 的交互风格,强烈建议入坑。

Hermes 的 slash 命令体验几乎一模一样,/tools、/model、/skills、/personality 一应俱全,上手零学习成本,但多了记忆、自学习和多平台聊天这些 Claude Code 没有的东西。

如果你技术底子好,两个都装,各取所长。这两只虾不是替代关系,是两种信仰。

五、写在最后:两条路,两种信仰

小龙虾和 Hermes 的分歧,表面上是功能对比,实际上是设计哲学的根本差异。

小龙虾的信仰是:人来指挥,AI 来执行。给用户最大的控制权,所有 Skills 都是人写的,所有记忆都是人确认的。它的假设是:人比 AI 更知道该干什么。

Hermes 的信仰是:让 AI 自己学会怎么干活,人只需要说一次。程序性记忆自动提炼,Skills 自动进化,安全边界框架锁定。它的假设是:AI 可以积累经验,越用越懂你。

两条路,两种信仰,你选哪条?

这不是替代关系,是两种路径。这个分歧,可能决定 AI 助手这个品类最终长成什么样。你选哪条路?